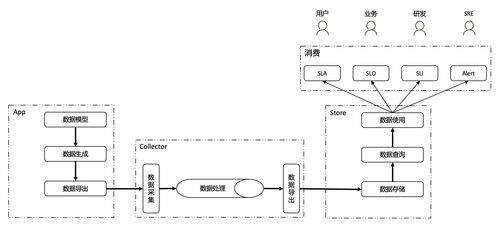

Kubernetes稳定性保障手册 可观测性专题之数据处理与存储服务

引言

在Kubernetes生产环境中,确保数据处理与存储服务的稳定性至关重要。这类服务(如数据库、消息队列、对象存储等)通常承载着应用的核心状态和数据流,其故障可能导致业务中断或数据丢失。可观测性(Observability)是保障这些服务稳定运行的基石,它使我们能够深入理解系统内部状态、快速定位问题并预测潜在风险。本专题将深入探讨如何为Kubernetes中的数据处理与存储服务构建全面的可观测性体系。

一、核心观测维度与指标

数据处理与存储服务的可观测性需覆盖三个核心维度:度量(Metrics)、日志(Logs)和追踪(Traces)。

1.1 关键度量指标(Metrics)

服务健康度:Pod就绪状态、存活探针成功率、服务端点可用性。

性能指标:

* 吞吐量:每秒查询数(QPS)、每秒事务数(TPS)、每秒读写操作数(IOPS)。

- 延迟:请求处理延迟(P50, P95, P99)、网络往返时间。

- 资源利用率:CPU、内存使用率,磁盘I/O吞吐量与延迟,网络带宽。

- 容量指标:存储使用量、连接数、队列深度、表空间或分区使用率。

- 错误指标:失败的请求数、客户端连接错误、慢查询数量、复制延迟(对于分布式存储)。

1.2 日志(Logs)

服务日志:记录所有操作、错误、警告和慢查询。需结构化输出(如JSON格式),便于解析。

审计日志:记录所有数据访问和变更操作,用于安全与合规。

* Kubernetes事件:关注与StatefulSet、PersistentVolumeClaim(PVC)等相关的事件。

1.3 分布式追踪(Traces)

* 跟踪跨多个微服务或数据库分片的一个请求的完整生命周期,特别适用于分析复杂查询或事务链路的性能瓶颈。

二、数据采集与集成方案

2.1 指标采集

使用Prometheus生态:为数据处理服务部署专用的Exporter(如mysqld_exporter, redis_exporter, kafka-exporter),或确保服务原生支持Prometheus指标端点。

利用cAdvisor & kube-state-metrics:监控容器和Kubernetes资源层面的指标。

* 存储特定工具:对于云托管服务(如RDS、ElastiCache),利用云供应商提供的监控指标并集成到Prometheus。

2.2 日志收集

采用Sidecar或DaemonSet模式部署日志代理(如Fluentd、Fluent Bit、Filebeat)。

将日志统一发送至中心化平台(如Elasticsearch、Loki),并进行索引。

* 关键实践:为日志添加丰富的Kubernetes元数据(Pod名称、命名空间、标签),并设置合理的日志轮转与清理策略,避免耗尽节点磁盘。

2.3 追踪集成

* 在应用代码及数据库驱动中集成OpenTelemetry或Jaeger等SDK,并确保追踪上下文在服务间传播。

三、存储与可视化

3.1 时序数据存储

* Prometheus长期存储:对于历史数据分析和趋势预测,将Prometheus数据远程写入到VictoriaMetrics、Thanos或M3DB等长期存储方案中。

3.2 可视化与告警

Grafana仪表盘:为核心服务创建专属仪表盘,综合展示性能、容量、健康状态。典型视图应包括:

服务概览(健康状态、请求量、错误率)。

- 资源消耗(CPU/内存/磁盘趋势)。

- 性能分析(延迟分位数、吞吐量)。

- 容量规划(存储增长预测、连接池使用率)。

- 智能告警:基于Prometheus Alertmanager或Grafana Alerting配置告警规则。告警应分层级:

- 紧急(Paging):服务不可用、数据不一致、磁盘即将写满。

- 警告(Warning):延迟持续升高、错误率增长、容量使用率超过80%。

- 信息(Info):配置变更、副本集状态变化。

四、稳定性保障专项实践

4.1 存储层稳定性观测

Persistent Volume(PV)监控:密切监控PVC的容量、可用性及PersistentVolume的phase状态。设置磁盘空间不足的预警。

存储类(StorageClass)与性能:观测不同StorageClass提供的卷的IOPS和吞吐量是否满足预期,尤其是对性能敏感的数据服务。

* 有状态工作负载(StatefulSet):监控Pod有序启停、网络标识稳定性以及与PV的绑定关系。

4.2 数据一致性观测

主从/集群状态:对于分布式数据库(如MySQL主从、Redis Cluster、Cassandra),监控副本同步状态、主节点选举、集群分区情况。

数据备份与恢复:监控备份作业的成功/失败状态、备份数据大小、恢复点目标(RPO)是否符合预期。

4.3 混沌工程与可观测性联动

在受控环境中,通过混沌工程工具(如Chaos Mesh)模拟节点故障、网络分区、IO延迟等场景。

观察可观测性仪表盘如何反映这些故障,验证告警是否及时触发,并评估追踪和日志是否能有效辅助根因分析。这有助于打磨可观测性体系的完备性。

五、与最佳实践

保障Kubernetes中数据处理与存储服务的稳定性,是一个将可观测性深度融入运维生命周期的过程。关键如下:

- 观测先行:在部署关键数据服务前,先规划和部署其可观测性方案。

- 多维覆盖:务必结合指标、日志、追踪三个维度,构建立体化的观测视图。

- 聚焦业务SLA:所有监控指标和告警阈值都应与服务的业务级SLA(如可用性、延迟要求)对齐。

- 自动化与闭环:将可观测性数据与自动化运维平台(如Kubernetes Operator)结合,实现故障自愈、弹性伸缩等高级能力。

- 持续演进:定期回顾告警有效性、仪表盘使用率,并根据业务增长和技术演进不断优化可观测性体系。

通过实施本手册所述的可观测性实践,运维与开发团队能够获得对数据处理与存储服务内部状态的深刻洞察,从而显著提升Kubernetes集群的稳定性和数据服务的可靠性,为业务的平稳运行奠定坚实基础。

如若转载,请注明出处:http://www.wzewkaew.com/product/26.html

更新时间:2026-05-27 13:43:00